La insoportable levedad del test de Turing y la filosofía del Minotauro (Manuel Corroza)

Ojalá

me lleve a un lugar con menos galerías y menos puertas. ¿Cómo será mi

redentor?, me pregunto. ¿Será un toro o un hombre? ¿Será tal vez un toro

con cara de hombre? ¿O será como yo?

[Jorge Luis Borges, "La casa de Asterión"]

[Jorge Luis Borges, "La casa de Asterión"]

NOTA

PREVIA. Esta entrada quiere ser una reflexión filosófica sobre el

denominado 'test de Turing', un experimento que pretende responder al

interrogante sobre la capacidad pensante de las computadoras, tal y como

Alan Turing lo planteó en su artículo de 1950 'Computing Machinery and

Intelligence'. No se pretende, por tanto, elaborar una crítica de amplio

alcance sobre la Inteligencia Artificial, ni sobre la posibilidad de

que los ordenadores puedan llegar a pensar algún día, ni sobre la

naturaleza computacional o no computacional del funcionamiento mental de

los seres humanos, ni siquiera sobre la teoría materialista de la mente

o sobre la perspectiva dualista mente-cuerpo. Trata este texto, por

tanto, de ceñirse al diseño original de la prueba de Turing, a hacer

explícitas algunas asunciones tácitas de dicha prueba, a realizar una

crítica filosófica de tales asunciones y a extraer algunas consecuencias

derivadas de aquéllas, como quien extrae el hilo de una madeja. Pero

este desmadejado no siempre conduce a una zona limpia y clara: a veces,

como en el caso de Teseo, uno se da de bruces con el Minotauro. Tal vez

sea éste el caso.

Imaginemos

la siguiente situación, haciendo abstracción de sus implicaciones

éticas e incluso penales. Deseo gastar una broma a un amigo. Es un amigo

soltero que frecuenta los canales de contactos por internet, en busca

de pareja. Su canal preferido es uno cuya configuración permite que el

intercambio de mensajes entre dos personas pueda ser observado, en modo

oculto, por uno o más terceros. Conozco bien a mi amigo, sé de sus

gustos en cuestión de mujeres -vamos a suponer que es heterosexual,

aunque esto resulta irrelevante para nuestro propósito- y de sus

aficiones literarias, deportivas, gastronómicas y cinematográficas.

Creando un perfil falso de mujer, el perfil A, me introduzco en ese

canal y busco establecer un primer contacto con él. Al mismo tiempo, me

aseguro de que ese intercambio esté a la vista de terceras personas en

modo oculto para mi amigo, aunque no para mí. De un modo similar, puedo

acceder a un foro paralelo, dentro del canal bajo un segundo perfil de

usuario, el perfil B, en el que esos "mirones" intercambian sus propios

puntos de vista. Poco a poco empiezo a mantener conversaciones cada vez

más largas con mi amigo, siempre bajo el escondido escrutinio de los

otros usuarios. Al cabo de un tiempo, los mensajes entre mi amigo y mi

falso perfil femenino A llegan a ser extremadamente afectuosos. Conforme

avanza nuestra relación virtual, voy leyendo y clasificando los

comentarios que en el foro paralelo realizan nuestros emboscados

observadores, sin intervenir en ellos o interviniendo de forma trivial

bajo el perfil B. Transcurrido un tiempo prudencial, introduzco en el

foro oculto de comentaristas la siguiente pregunta: ¿vosotros creéis que

Menganita (en referencia a mi perfil de usuario A) se ha enamorado de

Fulanito (en referencia a mi amigo)? Supongamos que de los veinte

mirones ocultos, catorce opinan que sí y seis, que no. Es decir, un 70 %

de los consultados afirman que Menganita (mi perfil A) se ha enamorado

de Fulanito (mi amigo). ¿Sería lícito concluir que, puesto que hay una

conspicua mayoría que así lo cree, Fulanita ama a Menganito? ¿Que existe un amor -tal vez correspondido, tal vez no, pero eso poco importa- entre ambos usuarios del canal de contactos?

Describamos una segunda situación, ésta real. Se trata del famoso experimento de Milgram,

llevado a cabo por Stanley Migram, profesor de psicología de la

Universidad de Yale, en 1963. En él, y con la excusa de la realización

de una serie de estudios sobre el aprendizaje y la memoria, Milgram y su

equipo diseñaron un experimento en el que unos cuantos voluntarios

recibieron instrucciones de interrogar sobre cuestiones triviales a un

grupo de personas y de aplicar un castigo en forma de descarga eléctrica

a aquéllas que respondiesen erróneamente. En la escenificación del

experimento, el investigador y el voluntario se sentaban a un mismo lado

de una mesa; al otro lado, y separada por una mampara que la ocultaba a

la vista, se colocaba la persona interrogada. El voluntario debía

aplicar descargas eléctricas de voltaje creciente -enre 45 y 450

voltios- a los sujetos interrogados que fallaran progresivamente en sus

respuestas a las preguntas formuladas, siempre bajo la supervisión y la

responsabilidad última del investigador. Conforme el voltaje aplicado

aumentaba, los interrogados manifestaban un dolor cada vez mayor por

medio de gritos, convulsiones y golpes en la mampara de separación. Por

supuesto, el experimento era un simulación en todos sus aspectos: las

personas interrogadas eran, en realidad, colaboradores del equipo de

Milgram que debían fingir dolor y el cableado y el equipo de descargas

eran falsos. Pero los voluntarios ignoraban ambos extremos. Los datos

recabados tras la finalización de los ensayos fueron ciertamente

sorprendentes: por supuesto, todos los voluntarios creían haber

infligido daños físicos a las personas a las que habían interrogado.

Más allá del intenso debate ético que el experimento ocasionó, y

prescindiendo de consideraciones psicológicas y morales sobre la

idoneidad de este tipo de protocolos experimentales, la cuestión que nos

interesa es la siguiente: puesto que todos los voluntarios cayeron en el engaño de la simulación y creyeron sinceramente que estaban causando sufrimiento físico a otras personas, ¿realmente existió este daño físico?

Las dos situaciones descritas más arriba plantean una misma cuestión: ¿es condición suficiente para la existencia de un estado mental la creencia

(por consenso o por amplia mayoría) de que tal estado mental existe? O,

en otras palabras, ¿puede la existencia de un estado mental ampliamente

compartido en un grupo de personas (la creencia, en este caso) producir

o generar la existencia de un estado mental diferente (el amor o el

sufrimiento) en una persona distinta, que no pertenece al grupo?

Esta

pregunta subyace, se quiera o no, a uno de los textos científicos más

importantes de los últimos cincuenta años, el artículo Computing Machinery and Intelligence ("Máquinas de computación e inteligencia", aquí en castellano), que el matemático británico Alan Turing publicó en la revista Mind

en 1950. Se considera que este escrito constituye una reflexión seminal

en el desarrollo de la inteligencia artificial y en el enfoque

funcionalista del estudio de la mente y de su correspondiente aderezo

filosófico, la perspectiva funcionalista y computacional de la

naturaleza e los estados mentales.

Por

supuesto, la interpretación habitual de este texto es que se trata de

una exposición brillante y original -y ciertamente lo es, situada en su

contexto histórico- sobre la capacidad que tienen las máquinas

computadoras para "pensar". El propio artículo desvela al mundo sus

intenciones en su mismo comienzo: Propongo someter a consideración la siguiente pregunta: '¿pueden pensar las maquinas?'.

Más que la respuesta a esta pregunta, que el propio autor no ofrece de

una manera clara, lo interesante del artículo es el enfoque que presenta

y los supuestos implícitos de los que parte, que se dan por obvios,

pero que no lo son en absoluto.

Puesto

que Turing se confiesa incapaz de definir lo qué es "pensar", ofrece

una solución tan pragmática como arbitraria, y se remite al conocido

"juego de imitación". Las dos situaciones que se han descrito al

comienzo de esta entrada ilustran dos variantes de este juego, aunque

Turing parte de una versión original ligeramente distinta que luego

modifica para adaptarla a un hipotético experimento con máquinas

computadoras. Algunos autores han llegado a identificar hasta tres variantes

del juego de imitación, pero la idea original no resulta afectada, en

lo esencial. Se trata de ver si a través de un juego de preguntas y

respuestas entre dos participantes, que no se ven las caras ni se pueden

oir, uno de ellos consigue engañar al otro acerca de su identidad. En

el caso del test de Turing, se trata de confrontar a un interlocutor

humano de forma aleatoria con otro ser humano o con una máquina

computadora, sin que el primer interlocutor conozca en cada momento la

identidad de su contraparte. Si la persona que está realizando el test

no es capaz de distinguir, en una proporción preestablecida de los

ensayos, si su contraparte es otra persona o si es una máquina

computadora, entonces uno está legitimado para afirmar que la máquina en

cuestión, "piensa". Turing se atreve incluso a proporcionar un criterio

numérico: si el examinador promedio no logra la identificación correcta

más que un máximo de siete de cada diez veces durante intervalos de

cinco minutos de preguntas y respuestas, puede afirmarse que la máquina

ha superado el juego de imitación. Puede afirmarse que la máquina

piensa.

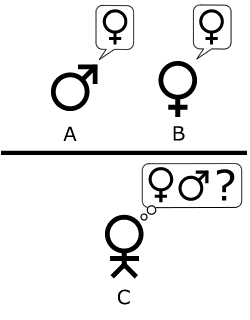

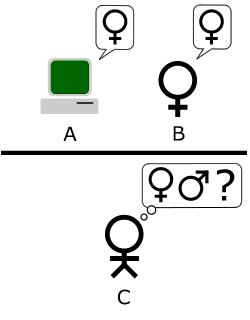

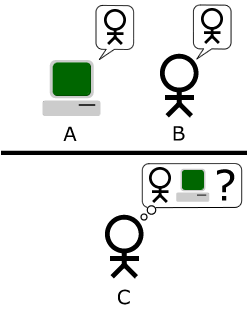

De

izquierda a derecha: el juego original de imitación con tres

interlocutores humanos, el juego de imitación con la sustitución de uno

de los interlocutores oculto por una computadora y por último, la

interpretación estándar del test de Turing, que aparece en el artículo

'Computing Machinery and Intelligence'. [Gráficos tomados del artículo de Wikipedia "El test de Turing"].

No

es difícil darse cuenta de que la transición desde la pregunta original

"¿pueden pensar las maquinas?" hasta la pregunta "¿pueden las máquinas

computadoras pasar satisfactoriamente el juego de imitación"? se

convierte en un enorme salto metodológico al vacío que Turing no se

molesta en justificar más que con la ayuda de un argumento ad ignorantiam:

puesto que no sabemos exactamente qué significa "pensar" y qué

significa "máquina", utilícese un critero operacionalista que sustituya

el significado de nuestro objeto de estudio por el diseño experimental

de un test de control. Diseño experimental que por fuerza, y malgré

el empirismo ingenuo, ha de incluir una idea preliminar de aquello que

se quiere testar, aunque sea una idea que se maneja como si se tratara

de una caja negra conceptual. Una caja negra de la que, sin embargo, se

extraen algunas características observables. O, por mejor decir, las

características que Turing postula como observables. Y este es

el problema que suelen arrastrar los criterios operacionalistas o

empiristas del significado: la selección arbitraria de ciertas

propiedades fenoménicas, visibles, de un objeto de estudio que funciona

como una caja negra y del que ni siquiera se intenta una definición

preliminar, siquiera a título provisional.

Dejando

aparte el hecho de que, en la investigación científica, dar prioridad a

la metodología sobre la semántica no es una buena idea -un investigador

debería saber qué es lo que quiere estudiar antes de diseñar el correspondiente protocolo experimental, el qué antes del cómo-

la propia selección de las mentadas características puede conducir a un

sesgo indeseado en las conclusiones. ¿Por qué, por ejemplo, decide

Turing que el juego de imitación, un juego basado en preguntas y

respuestas sobre una variedad de temas, es más adecuado para monitorizar

la capacidad pensante de una computadora que la realización de un

complicado cálculo numérico? La única justificación que ofrece es que la

realización de tales cálculos delataría de inmediato a la máquina en el propio juego de imitación.

Pero se trata de una respuesta circular, ya que presupone el propio

contenido de la pregunta. O, de otro modo, ¿por qué la capacidad de una

computadora para jugar al ajedrez, o a una versión complicada del Tres

en Raya, no se considera un criterio de inteligencia pensante

suficientemente válido? Pues los juegos son, en el fondo, interacciones

dialogadas a través de la utilización de un lenguaje normado,

interacciones que echan mano de la capacidad de observación atenta,

anticipación, razonamiento y argumentación inferencial, características

igualmente observables en lo que se entiende como "pensar". Y en esto,

los fenomenistas y los empiristas lógicos estarían de acuerdo. Pero

Turing no entra en explicaciones. Last but no least, en la época del floruit

intelectual de Alan Turing existían varias definiciones y estudios

disponibles sobre la mente y la actividad pensante, definiciones y

estudios que podrían haber servido como una primera referencia para el

diseño del experimento de las máquinas pensantes, pero nuestro autor

parece ignorarlos deliberadamente.

A

esta primera objeción, de carácter metodológico, cabría añadir una

segunda, muy vinculada a ésta, pero con un perfil más epistemológico e

incluso con cierta derivaciones ontológicas. En efecto, más allá de los

cuestionables principios operativos del test de Turing, el instrumental

epistémico que se pone en uso no puede ser más objetable. Veamos: se

trata de determinar si realmente el hecho de que una computadora

"supere" el juego de imitación -bajo la doble arbitrariedad de la

elección del propio juego y del criterio numérico establecido para

sancionar esa superación- implica que esa computadora pueda

pensar. ¿Qué justificación presenta Turing en favor de esa tesis? Lo

único que nuestro matemático puede alegar en su favor es el conductismo ingenuo y el criterio empirista del significado.

El primero niega la pertinencia de los estados mentales en el estudio

científico del comportamiento y sólo toma en consideración la conductas

manifiestas. El segundo afirma que sólo las proposiciones protocolares

que describen lo observado en un experimento o cuyo contenido puede ser

confirmado por la experiencia tienen significado cognoscitivo. Contra el

conductismo ingenuo, el propio Turing introduce la función mental del

"pensar" como el objeto de estudio que debe ser testado; es decir, da por supuesta

la existencia del pensamiento como un estado de la mente, aunque rehúse

definirlo. Contra el criterio empirista del significado cabe argüir que

todo diseño experimental y toda recolección de datos debe partir de una

criba previa sistemática, cuyo fundamento es el conjunto de

suposiciones teóricas preexperimentales que establecen cuáles son los

datos pertinentes, a efectos explicativos, predictivos y confirmatorios o

no confirmatorios. No todas las conversaciones, reales o

simuladas, son expresiones fidedignas de la actividad pensante de los

seres racionales. Pero Turing no establece un criterio preliminar en

este sentido, porque no tiene una teoría sobre el pensamiento.

Además,

la conclusión del experimento de simulación se apoya en la agregación

de los resultados procedentes de los estados subjetivos y de las

percepciones interiores de los participantes (su capacidad para ser o no

ser "engañados" por la simulación computacional de una discusión con

otra persona) , más que en el tratamiento estadístico de una serie de

datos evaluables de forma objetiva y con márgenes definidos de error

experimental. La agrupación de creencias individuales coincidentes -por

ejemplo, coincidentes en que el interlocutor es un ser humano y no una

máquina- no deja de ser una creencia agrupada o, si se quiere, una

creencia compartida entre varios o entre muchos, pero creencia, al fin y al cabo ¿Es epistémicamente riguroso postular la existencia de un estado mental con base únicamente en la existencia de otro

estado mental más o menos compartido? Retomando la primera situación

con la que se abre esta entrada, ¿hay algún tipo de robustez inferencial

en concluir que existe un estado mental de amor en una persona tan sólo

porque existe otro estado mental compartido por terceros -la creencia o

convicción más o menos conspicua- que así lo estipula?

Pero

del planteamiento del test de Turing pueden, además, inferirse

legítimamente algunas cuestiones ontológicas. Estas cuestiones cobrarían

forma a través de una interpretación estricta y rigurosa de la

propuesta de nuestro autor. Pues si lo que se propone en Computing Machinery and Intelligence es que la existencia de capacidad pensante en computadoras depende de una decisión

basada en un agregado de reacciones individuales en el juego de

simulación y en un cierto criterio numérico de corte aplicado sobre

dicho agregado, ¿no se está afirmando que la existencia del pensamiento

-y de la mente como conjunto de estados y funciones mentales- en un

individuo o entidad surge de un acto volitivo -la decisión de postular

esa existencia-, que no es, mutatis mutandis, sino otro estado mental, otra forma de pensamiento? ¿un acto volitivo que es además, exterior al individuo o entidad del que se postula su capacidad pensante? Ya no estamos hablando de la inferencia de la existencia de otras mentes por medio de un procedimiento epistemológicamente deficiente, sino de la creación

de esas otras mentes por un acto, también mental, externo a éstas. Una

propuesta de esta naturaleza se situaría a medio camino entre el

idealismo subjetivo clásico y un particular solipsismo colectivo de

alcance reducido. Llevaría implícita, además, una confusión muy

meritoria entre creer y crear. Volviendo a los dos

ejemplos con los que se abre esta entrada, la aplicación estricta de los

supuestos del test de Turing nos permitirían concluir que la creencia mayoritaria de los usuarios ocultos del canal de contactos en el enamoramiento de Menganita (mi falso perfil A de usuario) crearía,

de hecho, ese amor en tanto estado mental. También nos daría todas las

facilidades para afirmar que los voluntarios en el experimento de

Milgran estaban generando un dolor real, tan sólo por su propia convicción de que tal dolor estaba ahí.

No

acaba aquí el deshilachado de las consecuencias filosóficas que se

derivan del test de Turing. Si, en efecto, sancionamos como pensante

a un dispositivo computacional capaz de superar el juego de imitación

(con independencia de las anteriores consideraciones epistemológicas y

ontológicas), nos vemos obligados a preguntarnos si tal dispositivo

puede conceptuarse como un ser vivo. Hasta el momento, todo

nuestro conocimiento científicamente avalado sobre pensamiento, mentes e

inteligencias remite a los portadores de tales propiedades, es decir, a

los organismos con un sistema nervioso mínimamente desarrollado. No

consta, dado el estado actual de nuestro conocimiento, la existencia de

mentes intangibles o incorpóreas o, como diría Gilber Ryle, de

"fantasmas" dentro de máquinas. Y el enorme desarrollo experimental de

la neurofisiologia cognitiva y emocional

no sanciona de ningún modo esa tesis platónica y cartesiana. Más bien

al contrario, los estados mentales, y la propia mente entendida como un

conjunto (esto es, un objeto conceptual, no real, en el sentido de

Bunge) de funciones mentales se identifican con procesos cerebrales

empíricamente detectables. Lo que viene a avalar los supuestos de la

teoría materialista de la mente de que no existen las mentes, sino los

organismos "mentantes". Pero estas afirmaciones colocan a los

postulantes convencidos del test de Turing ante un dilema importante: o

aceptan que el juego de imitación no es un diseño válido para detectar

capacidades pensantes o, si persisten en su empeño, han de certificar

que las máquinas pensantes son, en algún sentido, seres vivos. O bien se

mantienen fieles a una ontología idealista de corte platónico y, en

contra de la creciente evidencia científica, siguen defendiendo la

existencia de estados mentales inmateriales extracorpóreos. Algo que,

por cierto, no resulta infrecuente entre matemáticos y, tal vez, entre

programadores informáticos.

El artículo de Turing, pese a todo, ofrece interesantes reflexiones sobre las relaciones entre pensamiento y computación. Mencionemos unas cuantas.

El artículo de Turing, pese a todo, ofrece interesantes reflexiones sobre las relaciones entre pensamiento y computación. Mencionemos unas cuantas.

- La tesis de que la capacidad de almacenamiento y la velocidad de procesamiento de una computadora resultan claves en el éxito del juego de simulación (características que, por otra parte, tienen una importancia manifiesta en la capacidad para jugar al ajedrez, por ejemplo).

- El argumento de desestimación de los archiutilizados teoremas de Gödel, cuyos contenidos Turing no considera relevantes en la discusión.

- Su reconocimiento del "misterio" de la conciencia, como una concesión (muy medida, eso sí) a la importancia de contar de algún modo con una teoría de la mente.

- Su esbozo teórico del funcionamiento de la mente, que él entiende, grosso modo, como la resolución algorítmica programada de un problema para el que la máquina (incluida la máquina humana) ha sido diseñada y la detección programada de errores en sus propios procedimientos algorítmicos.

- Su particular visión del "argumento de la sorpresa", esgrimido, según él, por quienes niegan la capacidad pensante en máquinas computadoras.

- El criterio nomológico para describir la conducta de los seres humanos, que pivotaría sobre el carácter natural-legaliforme de las pautas de comportamiento observadas.

- La muy interesante propuesta de las supuestas capacidades supercríticas de la mente humana (la generación de todo un hatillo de ideas, susceptibles de estructurarse en un cuerpo teórico, a partir de una idea inicial que obraría como simiente, como el árbol de la mostaza surge espléndido desde la modesta semilla) como criterio de constatación de la presencia de mentes inteligentes.

- La sugerencia de un proceso de desarrollo intelectual en la programación de las computadoras que imite el aprendizaje de los niños pequeños, desde una perspectiva de aprendizaje condicionado que bascularía sobre la recompensa y el castigo.

- La introducción, tal vez de contrabando, de la idea de un "lenguaje simbólico" (es decir, un lenguaje referencial y por tanto con carga semántica), lenguaje orientado al proceso de aprendizaje mencionado en el punto anterior.

- Y, por último, la definición tentativa que Turing nos regala sobre el comportamiento inteligente: el comportamiento inteligente supuestamente consiste en apartarse del comportamiento completamente disciplinado que entraña la computación.

En definitiva, y pese a los premios Loebner,

que pretenden actualizar la vigencia de la propuesta original de Turing

y evaluar la "inteligencia" de los programas de ordenador siguiendo

escrupulosamente las pautas del juego de imitación el diseño

experimental ofrecido por este gran matemático suscita más dudas

filosóficas de las que pretende solventar. Dudas profundas que atañen a

la metodología, a la epistemología y a la propia ontología,

especialmente desde un punto de vista realista y materialista.

Probablemente por esta razón, el enfoque imitativo tiene en la

actualidad una importancia muy acotada en el amplio escenario de las

investigaciones sobre Inteligencia Artificial

y en el diseño de nuevos experimentos de detección de la conciencia en

ordenadores bajo criterios de discriminación visual, como los llevados a

cabo por Christof Koch y Giulio Tononi en 2008.

Sólo cabe esperar y ver si, deshilachada la madeja, al final del laberinto nos aguarda la confusa figura del Minotauro o más bien el rostro reconocible de uno de los nuestros.

NOTA AL PIE: Me informa Eparquio Delgado sobre el carácter fraudulento de los experimentos de Milgram tal y como aparecen en su descripción habitual en los medios académicos y de comunicación. Me enlaza este artículo, cuya lectura recomiendo. También me advierte sobre las frecuentes simplificaciones que los críticos del conductismo ponen sobre la mesa al hablar de esta corriente psicológica. Creo que son dos matizaciones muy interesantes, pero que no afectan, en lo esencial, a la argumentación que presento en esta entrada contra el test de Turing. Por una parte, podríamos imaginar que la descripción canónica del supuesto experimento de Milgram es en realidad un experimento mental, y las conclusiones no cambiarían gran cosa. Pues lo que me interesa resaltar de la real o supuesta investigación de Milgram es un aspecto muy secundario -el juego de simulación y el convencimiento de los participantes de que estaban infligiendo un dolor real-, un aspecto que no resulta particularmente controvertido y sobre el que sólo cabe hacer matizaciones numéricas. En cuanto al conductismo, y con independencia de las propuestas reales de Watson y Skinner, el test de Turing, tal y como lo describe su autor, parece ejemplificar una forma radical, ingenua o incluso caricaturesca de las tesis conductistas más serias. Que quepa o no adscribir con rigor este test al conductismo tiene, en realidad, poca importancia, y no afecta a la crítica filosófica general que merece la propuesta de Turing.

Sólo cabe esperar y ver si, deshilachada la madeja, al final del laberinto nos aguarda la confusa figura del Minotauro o más bien el rostro reconocible de uno de los nuestros.

NOTA AL PIE: Me informa Eparquio Delgado sobre el carácter fraudulento de los experimentos de Milgram tal y como aparecen en su descripción habitual en los medios académicos y de comunicación. Me enlaza este artículo, cuya lectura recomiendo. También me advierte sobre las frecuentes simplificaciones que los críticos del conductismo ponen sobre la mesa al hablar de esta corriente psicológica. Creo que son dos matizaciones muy interesantes, pero que no afectan, en lo esencial, a la argumentación que presento en esta entrada contra el test de Turing. Por una parte, podríamos imaginar que la descripción canónica del supuesto experimento de Milgram es en realidad un experimento mental, y las conclusiones no cambiarían gran cosa. Pues lo que me interesa resaltar de la real o supuesta investigación de Milgram es un aspecto muy secundario -el juego de simulación y el convencimiento de los participantes de que estaban infligiendo un dolor real-, un aspecto que no resulta particularmente controvertido y sobre el que sólo cabe hacer matizaciones numéricas. En cuanto al conductismo, y con independencia de las propuestas reales de Watson y Skinner, el test de Turing, tal y como lo describe su autor, parece ejemplificar una forma radical, ingenua o incluso caricaturesca de las tesis conductistas más serias. Que quepa o no adscribir con rigor este test al conductismo tiene, en realidad, poca importancia, y no afecta a la crítica filosófica general que merece la propuesta de Turing.

Excelente. Estoy de acuerdo. Massimo Pigliucci también:

ResponderEliminarhttps://youtu.be/L-rOe0nwieQ?t=13m20s

Yo, no.

ResponderEliminarSi entiendo bien, la primera objeción es un argumento por analogía. Si alguien puede imitar los efectos del dolor y engañar a un observador, entonces podemos concebir que algo pueda imitar los efectos de pensar y también engañar a un observador. Pensar, e interactuar con el pensamiento con otro ser pensante, es una actividad mucho más compleja que imitar el dolor. La analogía no es buena.

Pero aún así, el test sigue diciendo algo que no se refuta: si no tienes manera de distinguir si estás interactuando con un ser pensante o con una máquina que lo imita sigues sin tener ninguna razón para atribuir pensamiento al primero y no al segundo. Por definición de haber pasado el test de Turing. Si cuando cumples las bodas de oro con tu pareja te confiesa y te muestra que bajo la tapa de los sesos tiene cablecitos y chips en lugar de materia gris, ¿dirás que tu pareja no pensó durante los años que te tuvo engañado?

José Luis:

ResponderEliminarTu primera objeción no me parece muy sólida. Si consideras que la analogía deel experimento de Milgram es deficiente, puedes imaginar un experimento mental que parta de esa misma situación, pero enriquecido con nuevas expresiones de conducta y nuevos comportamientos simulados. Ésos no sólo reflejarían sufrimiento por el dolor físico (como en Milgram), sino también otros estados mentales más o menos asociados: angustia, ansiedad, alivio, esperanza, intentos de razonamiento con el "torturador", búsqueda de empatía y otros más. Es decir, puede uno imaginar un experimento mental que complete el experimento real de Milgram añadiendo un conjunto de nuevos estados mentales simulados que se acerquen más a la panoplia de conductas simuladas que contempla el test de Turing.

Aunque esto tampoco es necesario. El primer experimento mental que describo en la entrada, el del canal de contactos por internet, contempla una situación dialogada entre dos usuarios -uno de ellos impostado- en la que pueden tener cabida prácticamente todoas las conductas que uno esperaría ver en un test de Turing estándar.

De este modo, tanto la "ampliación mental" del experimento de Milgram como el experimento mental del canal online de contactos guaradn, tal y como yo lo veo, un parecido fuerte con la situación que Turing ideo para su test.

En cuanto a tu segunda objeción, si yo me encontrara ante una situación como la que describes, podría pensar una de estas dos cosas:

- O bien que el equipo de programadores informáticos y de constructores de equipos robóticos han hecho un trabajo impresionante, y no cabría sino felicitarles por ello, por haber conseguido tenerme engañado durante cincuenta años.

- O bien que, efectivamente, el robot que ha sido mi pareja durante tanto tiempo es una entidad capaz de pensar y albergar sentimientos y emociones.

Pero lo que nunca pensaría es que el hecho de haber sido engañado durante todo ese tiempo al pensar que mi pareja era un ser humano fuera condición suficiente para postular o decretar que el robot que en ese momento tengo delante es, realmente, un ser pensante y sintiente.

La situación, de nuevo las analogías, no hubiera sido muy distinta si mi pareja, en vez de ser un robot, hubiera sido una actriz que en el inicio de nuestra relación fue instruida sobre mi modo de ser y sobre el mejor modo de actuar ante un abanico amplio de situaciones cotidianas por, por ejemplo, un equipo de psicólogos que ya me conocía de antes. El hecho de haber creído lo que la actriz-pareja decía sentir por mi no convierte, de facto, esos falsos sentimientos en sentimientos auténticos.

Pero en realidad, las consideraciones anteriores son irrelevantes por el simple hecho de que la situación que planteas no es un test de Turing. Ni siquiera es, en principio, un juego de simulación.

Saudos.

El juego de simulación es una cosa, una manera limitada de entender el test de Turing, máxime cuando esas maneras son realmente limitadas, como el propio ejemplo que pone Turing en su artículo. Pero eso era solo una ilustración. El verdadero test consiste en darle la misma oportunidad a la máquina que a la persona. No una interacción corta, no un ambiente controlado, sino la misma completa interacción por la que atribuyes pensamiento a todo lo que se parece a las personas a quienes ya atribuyes pensamiento. Como en el caso de la pareja robótica. Dices que tienes dos posibilidades. Sí, una vez que lo sabes tienes dos posibilidades (por lo menos) sobre qué creer, pero solo una de ellas es coherente con la única posibilidad que se asignabas antes de saber que era una máquina. En cualquier caso, el test es lo que la máquina pasaba antes de tú saber que lo era. Y antes de saberlo tú no tenías ningún motivo para atribuir a tu hermana inteligencia y capacidad de pensar y a tu pareja no. De eso se trata. Si no puedes distinguir, no puedes atribuir cosas distintas.

EliminarEl problema del test es el uso equívoco del término "pensar". Si de entrada definimos "pensar" exclusivamente como competencia lingüística, de salida no podemos atribuir estados mentales ni a las máquinas ni a las personas. Hoy atribuímos estados mentales a otras personas por analogía con los propios, porque las otras personas son los únicos seres lingüísticamente competentes que conocemos. Pero es el hábito lo que hace convincente la analogía. Si empezamos a relacionarnos con robots parlantes, antes de concederles derechos, querremos saber lo que cuece su caja negra. La dimensión pragmática del habla, la comprensión de su contenido tácito o la creación de metáforas de nuevo cuño, queda fuera del alcance de las máquinas sintácticas. Si algún día, algo distinto a un ser humano llega a pasar el test de Turing, albergará un cerebro artificial, no una máquina sintáctica. La realización múltiple de una función en distintos sustratos no es lo mismo que la simulación de sus resultados. La aceptación del test como prueba de estados mentales es un atajo injustificado al computacionalismo psicológico. Da la vuelta al calcetín para que pensemos en los seres humanos como máquinas sintácticas capaces de pasar el test. No cuela.

EliminarTuring es muy claro en su artículo al describir el juego de simulación como base de su test, y hasta donde yo sé él no desarrolló posteriormente este diseño. Por lo tanto, hablar en rigor del "test de Turing" es hablar del experimento mental que él mismo presentó en su artículo 'Computering machinery and intelligence'. Turing desecha la necesidad de una simulación más completa -por ejemplo, dotando a la máquina de una apariencia humana indistinguible de una persona biológica- y creo que esto es importante. Él afirma que su diseño de simulación es condición suficiente para testar la capacidad pensante de una máquina. No ve la necesidad de imaginar situaciones distintas con ambientes no controlados ni interacciones duraderas con robots antropomorfos. Turing es muy claro al respecto: interacciones de cinco minutos y porcentaje de fallos sobre la identidad del interlocutor oculto del treinta por ciento o superiores. Con base en lo que Turing considera condición suficiente yo me permito criticar su propuesta, la que aparece en su artículo: es metodológicamente deficiente, epistemológicamente incompleta y genera serios problemas desde una interpretación ontológica. Y al desarrollar la idea, lo que Turing nos dice es que no estamos testando las propiedades pensantes de una máquina particular -él insiste sobre este punto- sino las propiedades pensantes de una "máquina abstracta" que no es otra cosa sino un programa informático.

ResponderEliminarLo que se está testando en la situación de interacción continuada con el robot antropomorfo no es, desde mi punto de vista, sólo el funcionamiento de un sofisticado software, sino la ejecución de éste en una máquina cuyos principios de construcción y cuya arquitectura computacional podrían replicar -no simular, sino replicar- tan al detalle la estructura neural de un ser humano que resultaría razonable suponer a ese ente robótico dotado de inteligencia. O podría no ser así. Pero en todo caso esa suposición se haría con base en un estudio detallado de ambos ingredientes, el programa informático y la arquitectura computacional física del robot. Por esta razón sostengo que el escenario que esatmos imaginando es muy distinto del diseño original del test de Turing, que es en el yo centro mis críticas.

Pero el quid de la cuestión, a mi modo de ver, sigue siendo el mismo: ¿con base en qué mis creencias originales sobre la naturaleza humana de mi pareja, creencias sostenidas durante poco o mucho tiempo y que a la postre resultaron equivocadas, pueden decretar o postular la naturaleza pensante del robot que tengo delante? ¿hasta qué punto mis experiencias subjetivas sobre un objeto de estudio pueden determinar la verdadera naturaleza de ese objeto? La incapacidad de distinguir apariencias no es condición suficiente para atribuir identidad en las esencias, por decirlo de alguna manera. El principio de identidad de los indiscernibles de Leibniz no puede aplicarse en estas circunstancias.

Saludos.